端侧AI应用兴起,安谋“周易”NPU加速算力升级

2024年11月12日 20:44 发布者:eechina

沉睡多年后,人工智能(AI)再次醒来,其势如滔滔江河,不可阻挡。随着天量资本不断涌入,各种创新突破令人瞠目结舌。随后,AI技术快速向各个应用领域渗透,成为提升产品竞争力的利器。如今,AI部署已经从昂贵的数据中心云端蔓延到了寻常的应用终端,如手机、电脑和汽车,甚至可穿戴设备。端侧的硬件AI算力成为提升AI设备性能的重要一环。那么,端侧AI算力有何优势?如何才能有效提升终端算力?在近期举办的E维智库第12届中国硬科技产业链创新趋势峰会暨百家媒体论坛上,安谋科技产品总监鲍敏祺先生以“端侧AI应用‘芯’机遇,NPU加速终端算力升级”为题进行了讲解。

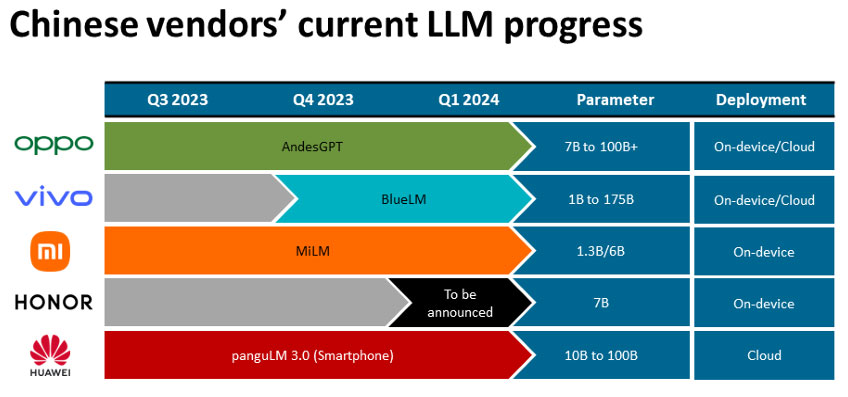

鲍敏祺以智能手机为例介绍了AI如何提升用户体验,包括AI大模型对语音、图片和视频的理解能力,以及其分析和总结能力,这些能力使得手机成为我们生活和工作中的得力助手。在AI的部署方式方面,以大语言模型(LLM)为例,厂商们的选择各有不同。目前,除华为以外,所有中国手机厂商都在不同程度地布署了设备端AI,如下图所示。

鲍敏祺介绍说,与单纯的云AI相比,端侧AI具备两个优势:时效性和数据的安全性。虽然云AI的算力更强大,能够获得更强的理解力,但其响应存在延迟。此外,由于端侧产品针对特定应用和特定用户,所以AI的学习训练也更加具有针对性,用户体验会更好,产品的用户粘度也就更高。

鲍敏祺说,由于内存带宽的限制(50-100GB/s),端侧大模型的规模一般被限制在1B至3B,而7B是临界值。从商业化的角度去看,芯片厂商达成了一个基本共识:消费类产品AI的未来投入重点是神经网络处理器(NPU)。为方便芯片厂商设计研发NPU,安谋科技推出了“周易”NPU IP,它在功耗、成本和生态系统诸方面都具有优势。

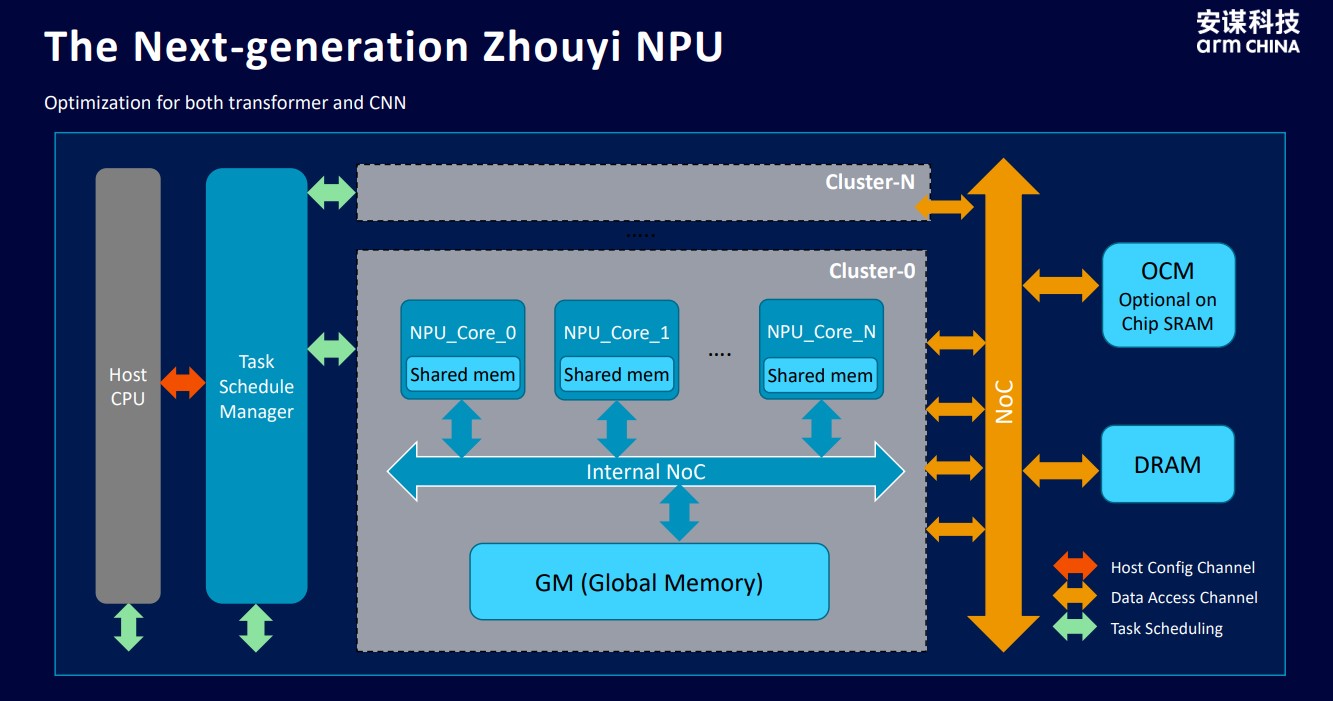

据介绍,“周易”NPU正朝着更高能效的方向演化。首先,其微架构实现了升级,保留了部分卷积神经网络(CNN)功能,增强了transformer语言大模型能力。第二,通过混合精度量化、片内互联、压缩和稀释等技术实现了更高效率。其次,通过数据/模型的并行处理、负载均衡和tiling技术提升了效率。“周易”NPU的结构如下图所示,重点是其任务日程管理器和异构策略。

鲍敏祺说,“周易”NPU可应用于智能汽车、智能手机、PC和AIOT等场景,其策略各有不同。下面是汽车应用的示例,其中不仅包含了安谋的“周易”NPU,也包含了安谋的山海SPU、玲珑VPU和玲珑DPU,以及Arm的Mali GPU和ISP。

鲍敏祺说,“周易”NPU能够涵盖ADAS、智能座舱、车载娱乐系统等不同汽车场景。上面的“周易”NPU具有20到320 TOPS可扩展性,以应对不同场景的不同算力需求。例如,车载信息娱乐系统(IVI)的要求不会很高,但ADAS在很多情况下要执行多任务,所以需要更高的算力。据悉,搭载了“周易”NPU的芯擎科技“龍鷹一号”芯片已累计出货超过40万片,并成功应用于吉利旗下的领克、银河系列以及一汽红旗等20余款主力车型中。对于下一代“周易”NPU,安谋会增强自动驾驶AI方面的算力和效率。