通过实时盲区检测提高车辆安全性

2024年08月05日 20:36 发布者:eechina

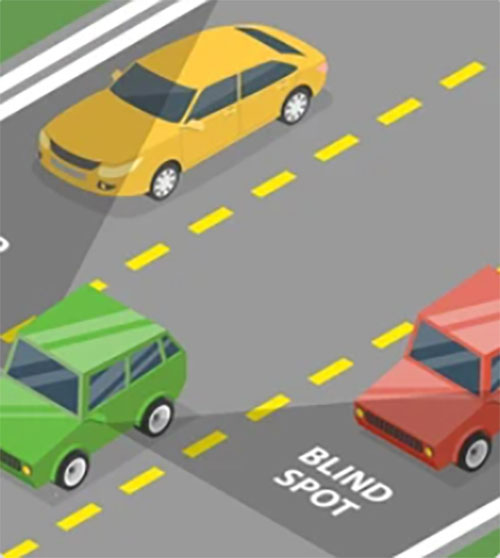

作者:e络盟技术团队车载汽车安全系统通过检测驾驶员盲区中是否存在相邻车辆,并警告驾驶员可能发生的事故来防止发生车祸。驾驶员可以使用此信息来安全地变道。在本文中,我们将讨论盲区检测技术。

图 1:盲区

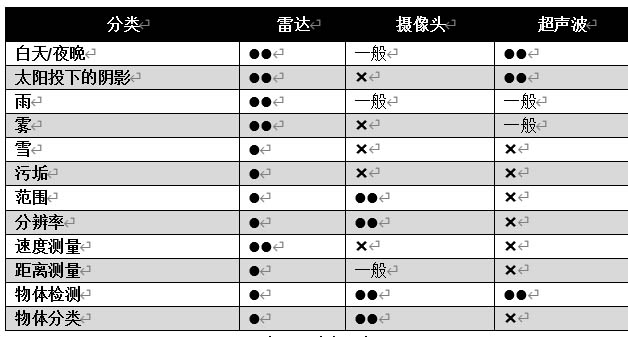

技术对比

转向辅助系统监控车辆附近驾驶员难以看到或无法看到的区域,并在必要时做出适当的反应。大多数转向辅助系统都会使用摄像头、雷达或超声波。

摄像头:具有摄像头的转向辅助系统通过数码摄像头来跟踪车辆周围的关键区域。驾驶员可以通过驾驶室内的监视器查看图像。这些系统通过算法来对骑车人、行人和其他物体进行分类。然而,这种分类需要进行大量的计算。摄像头系统的一个主要缺点是,在恶劣天气和异常照明条件下,其功能会受到影响。

超声波:使用超声波的转向辅助系统非常适合确定与物体的距离。该技术会测量系统发出声波经反射后的返回时间。然而,超声波转向辅助系统无法确定方向或速度,也无法准确地对检测到的物体进行分类。超声波传感器在夜间的工作效率很高,但与摄像头一样,容易受到雨、雪和污垢的干扰。

雷达:雷达转向辅助系统可以监测车辆侧面或后方区域中的物体。与超声波系统一样,雷达系统所发出的信号会被其监测范围内的物体反射回来。此外,他们还可以利用所谓的多普勒效应。因此,雷达可以准确测量距离和速度。与摄像头和超声波系统不同,雷达技术不受天气和照明条件等环境因素的影响。当通过算法增强时,这些系统可以对检测到的物体进行分类。

因此,这三种技术在性能方面有所不同。摄像头系统在物体分类和分辨率方面更胜一筹。更高的分辨率可以创建画质非凡的清晰图像。雷达系统在测距和测速时具有明显优势,并且与摄像头系统和超声波系统相比,更能适应各种环境条件。

表1:对比图表

开发基于雷达和摄像头的智能汽车盲区检测系统

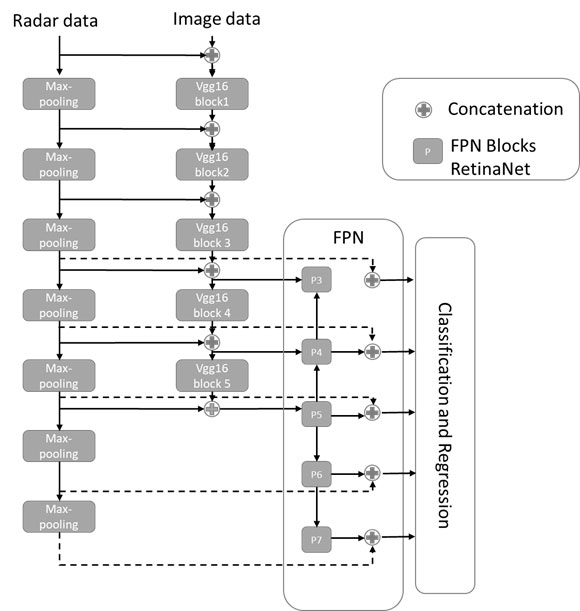

神经网络通过结合雷达和摄像头的数据来检测物体。神经网络基于RetinaNet,同时使用VGG骨干网,可输出边界框坐标的二维回归结果和分类分数。术语“骨干网”是指将输入数据合成为特定特征表示的特征提取网络。VGG在图像分类和物体检测方面非常有效。

神经网络可在焦点损失的情况下进行训练,基线方法会在第一个卷积层期间使用VGG特征提取器。经过专门设计,神经网络可以自行学习雷达和摄像头数据融合的最佳深度水平。图2显示了神经网络的高级结构。

图2:雷达和摄像头的结构

准备数据集和训练

本节介绍数据集的预处理和训练

雷达和nuScenes数据集预处理

雷达传感器分析方位角和雷达截面(RCS)等数据,以输出具有相关特性的二维点云。数据从二维地平面转换为垂直图像平面,并作为像素值存储在增强图像中。输入摄像头图像具有三个通道(红、绿、蓝),可与雷达通道相结合,构成神经网络的输入信号。来自三个雷达的点云被连接起来,并用作投影雷达输入。不同数据集的摄像头视场(FOV)也不尽相同,使用校准方法来将世界坐标映射到图像坐标中。由于雷达需要提供有关探测高度的信息,因此融合数据的难度就更大了。假设检测从地平面开始,并垂直扩展以考虑物体的高度。检测汽车、卡车、摩托车、自行车和行人等交通对象,并假设高度延伸为3米,然后将摄像头像素与雷达数据相关联。雷达数据被映射到像素宽度为1的图像平面中。

表2显示了nuScenes数据集被精简为用于检测评估的23个原始对象类。地面实况过滤器可能会,也可能不会被用于评估nuScenes结果。

训练

将nuScenes的原始数据拆分为60:20:20,以平衡训练集、验证集和测试集中的白天、雨天和夜晚场景的数量。NuScenes图像的输入尺寸为360 x 640像素。平均精度可以根据数据集中出现的对象类加权计算得出。Imagenet数据集用于预训练VGG 特征提取器的权重。在预处理过程中,摄像头图像通道进行了缩放,但雷达通道未进行缩放。数据扩增是为了增加数量相对较少的已标记数据。

表2:nuScene数据集各类对象

对象分类 nuScenes

汽车 22591

巴士 1332

摩托车 729

卡车 5015

拖车 1783

自行车 616

行人 10026

e络盟与许多不同的供应商合作,提供各种工业传感器和传感器连接器、组件、产品和解决方案组合,例如雷达、摄像头和超声波传感器。e络盟可为设计执行、开发和项目提供支持。

结语

盲区安全辅助系统可在驾驶过程中提醒驾驶员注意盲区中的各种潜在危险。该技术可降低事故风险,有助于提高驾驶者安全。该系统使用摄像头、超声波或雷达传感器来检测驾驶员盲区内的障碍物或其他车辆。报警信号会立即以独特的声音或灯光通知驾驶员。这三种技术各有优势。摄像头系统在物体分类和分辨率方面更胜一筹。在这三种技术中,雷达系统在测距和测速时具有明显优势,并且与摄像头系统和超声波系统相比,更能适应各种环境条件。