LeapMind发布超低功耗AI推理加速器IP“Efficiera v2版本”

2021年11月30日 17:23 发布者:eechina

根据v1版本使用记录和市场评测进一步完善,以应用于更多的实际产品LeapMind有限公司今日公布了其正在开发和授权的超低功耗AI推理加速器IP “Efficiera” v2版本(以下简称“v2”)。LeapMind于2021年9月发布了Efficiera v2的测试版,并收到了许多公司的测试及反馈,包括SoC供应商和终端用户产品设计师。Efficiera v2预计2021年12月开始发售,如有意向获取,请通过此邮箱垂询:business@leapmind.io。

LeapMind首席执行官Soichi Matsuda表示:“去年,我们正式推出了v1的商用版本,许多公司对Efficiera进行了评测。截至2021年9月底,我们共与8家日本国内公司签署了授权协议。‘向世界传播采用机器学习的新设备’是我们根据企业理念所设定的座右铭,而我们正通过提供v1来稳步推进这一理念的落地。在未来,我们将进一步通过技术创新和产品阵容扩展,继续努力实现人工智能的普及。”

Efficiera v2根据v1的使用记录和市场评测,扩大了应用范围,在保持最小配置的电路规模基础上,可覆盖更广泛的性能范围,并应用于更多的实际产品。产品由此得到了进一步的完善。

Efficiera v2概念

LeapMind董事兼首席技术官Hiroyuki Tokunaga博士表示:“自去年发布v1以来,我们强化了设计/验证方法和开发流程,旨在‘开发世界上最节能的DNN加速器’。我们一直在开发v2,以使产品能够适用于专用集成电路(ASIC)和专用标准产品(ASSP)。我们还在开发一个深度学习方面的推理学习模型,以便将超小量化技术的优势最大化。LeapMind的最大优势就在于我们可以提供一种技术来实现双管齐下。”

Efficiera v2的主要规格与特性

A. 在保持最小电路规模的同时,覆盖更广泛的性能范围,从而扩大应用范围。

硬件特性

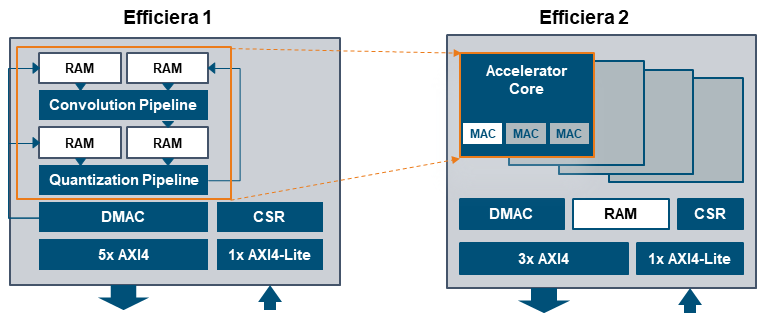

● 通过多路复用MAC阵列+多核,性能可扩展至48倍

V2允许你将卷积管道中的MAC阵列数量增加到v1的3倍(可选择x1、x4),并通过提供多达4个内核的选择,进一步扩大性能的可扩展性。

● 除卷积和量化外,还可实现硬件执行跳过连接和像素嵌入

1. 跳过连接是多层卷积神经网络(CNN)中常见的一种操作。(v1中由CPU执行)

2. 像素嵌入是一种对输入数据进行量化的方法

● 资源使用方面,配置与Efficiera 1相同

1. 有些应用只因AI功能可在规模有限的FPGA器件上实现就能创造价值。

2. LeapMind分析了一个实用型深度学习模型的执行时间,并仔细选择了额外的硬件功能。

集成到SoC中

● AMBA AXI接口

● AMBA AXI interface

AMBA AXI继续被用作与外部的接口,并且当接口被视为一个黑盒子时与以前一样,易于从当前设计中迁移。

● 单时钟域

FPGA中的目标频率

● FPGA的运行频率与先前相同,虽然取决于具体设备,但预计约为150到250MHz。

1. 256 GOP/s @ 125MHz (单核)

2. 高达12 TOP/s @ 250MHz (双核)

● 以加密RTL的形式提供

B. 通过改进设计/验证方法并审查开发流程,我们确保质量不仅适用于FPGA,也适用于ASIC/ASSP。

C. 开始提供一个模型开发环境(NDK),使用户能够为Efficiera开发深度学习模型。目前为止只有LeapMind实现了这项工作。

● 为Efficiera创建超小型量化深度学习模型所需的代码和信息包

● GPU深度学习模型的开发者可立即上手使用

● 支持PyTorch和TensorFlow 2的深度学习框架

● 学习环境为一个配备GPU的Linux服务器

● 推理环境为一个配备Efficiera的设备

● 来自LeapMind的技术支持

关于Efficiera

Efficiera是专用于CNN推理处理的超低功耗AI推理加速器IP。其在FPGA或ASIC设备上以电路形式运行。“超小量化”技术将量化位的比特数最小化到1-2位,将占了大部分推理处理的卷积功率和面积效率最大化,而无需先进的半导体制造工艺或特殊的单元库。通过该产品,深度学习功能可被整合至各种边缘设备中,包括家用电器等消费类电子产品,和建筑机械、监控摄像头、广播设备等工业设备,以及受制于功率、成本和散热的小型机器和机器人,这以过去的技术水平是很难实现的。如需更多信息,请访问产品网站:https://leapmind.io/business/ip/